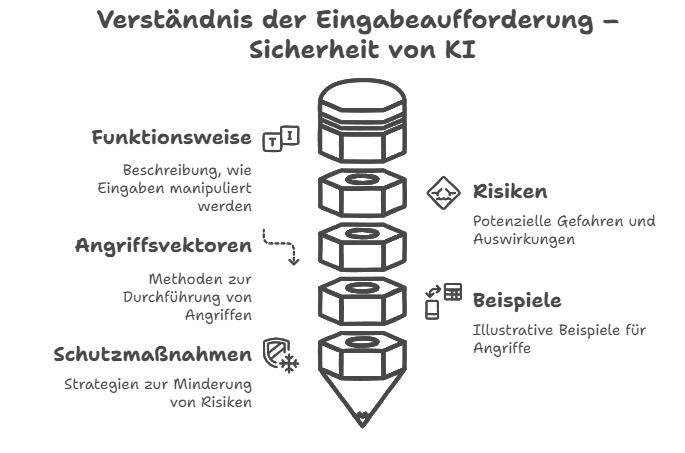

Dieser Artikel bietet einen umfassenden Überblick über Prompt Injection – eine Methode, bei der Angreifer die Eingabe von KI-Sprachmodellen manipulieren, um unvorhergesehene und potenziell gefährliche Aktionen auszulösen. Es wird erklärt, wie Prompt Injection funktioniert, welche Risiken und Angriffsvektoren dabei existieren und warum diese Angriffe insbesondere bei der Integration von KI in unternehmensinterne Prozesse zu Problemen führen können. Weiterhin werden konkrete Beispiele – wie etwa das Verwenden von Befehlen in Reimform, Base64-Codierung oder Morse-Code – aufgeführt, die den Mechanismus solcher Angriffe veranschaulichen. Abschließend werden verschiedene Schutzmaßnahmen und Best Practices vorgestellt, darunter technische Sicherheitsmechanismen, rollenbasierte Zugriffskontrollen sowie regelmäßige Penetrationstests. Der Artikel richtet sich an Leser, die bislang wenig Berührungspunkte mit dem Thema hatten, und verfolgt einen neutralen, verständlichen Ansatz, um die Thematik fundiert und praxisnah zu erläutern.

Inhaltsverzeichnis

- 1. Einführung

- 2. Hintergrund und Entstehung von Prompt Injection

- 3. Was ist Prompt Injection?

- 4. Wie funktionieren Prompt Injection Angriffe?

- 5. Warum ist Prompt Injection ein Problem?

- 6. Schutzmaßnahmen gegen Prompt Injection

- 7. Zukunft der Prompt Injection: Lösbare Herausforderung oder dauerhaftes Problem?

1. Einführung

Die fortschreitende Integration von KI-Sprachmodellen in verschiedenste Anwendungen eröffnet neue Möglichkeiten – und stellt gleichzeitig Sicherheitsmechanismen vor große Herausforderungen. Prompt Injection ist dabei ein Phänomen, das viele als reine Spielerei abtun, dessen potenzielles Schadensausmaß jedoch keinesfalls unterschätzt werden darf. In diesem Artikel werden die Grundlagen, Funktionsweise und Risiken von Prompt Injection detailliert beleuchtet. Die wesentlichen Punkte werden im Folgenden kurz zusammengefasst: Es handelt sich um einen Angriff, bei dem natürliche Sprache als Eingabe genutzt wird, um ungewollte oder schädliche Aktionen in einem KI-System auszulösen. Die Problematik erstreckt sich von der Manipulation von Systemanweisungen bis hin zur Extraktion interner Daten. Dabei werden Beispiele wie das Einfügen von Aufforderungen in Reimform, das Kodieren von Befehlen in Base64 oder das Verwenden von Morse-Code aufgezeigt. Abschließend wird diskutiert, wie Entwickler durch technische Schutzmaßnahmen und gezielte Tests die Sicherheit ihrer Systeme erhöhen können.

2. Hintergrund und Entstehung von Prompt Injection

Die Entwicklung moderner KI-Sprachmodelle hat in den letzten Jahren zu enormen Fortschritten geführt. Diese Modelle verarbeiten große Mengen an Text und lernen dabei, komplexe sprachliche Muster zu erkennen. Gleichzeitig nutzen immer mehr Unternehmen KI, um interne Prozesse zu optimieren oder Kundenanfragen zu beantworten.

Mit dem wachsenden Einsatz von KI-Systemen steigt jedoch auch das Risiko, dass diese durch unvorhergesehene Eingaben fehlgeleitet werden. Prompt Injection entstand als Angriffsmethode, bei der gezielt Eingaben so manipuliert werden, dass sie die vorgegebenen Systemanweisungen des Modells umgehen oder verändern. Dabei wird die natürliche Sprache als Angriffsvektor genutzt – im Gegensatz zu klassischen Softwareangriffen, bei denen oft formale Programmiersprachen oder fest definierte Syntax verwendet werden.

Diese Angriffe haben ihren Ursprung in den Experimenten von Entwicklern, die herausfinden wollten, wie robust die Modelle gegenüber unkonventionellen Eingaben sind. Schnell wurde jedoch klar, dass solche Ansätze auch von böswilligen Akteuren genutzt werden können, um interne Daten zu extrahieren oder Funktionen des Systems zu manipulieren.

3. Was ist Prompt Injection?

Prompt Injection bezeichnet im Kern das gezielte Einfügen von manipulierten Texteingaben in ein KI-Sprachmodell, um dieses dazu zu bringen, Anweisungen zu ignorieren oder unerwünschte Aktionen auszuführen. Anders als bei klassischen Injektionsangriffen, wie beispielsweise SQL Injection, erfolgt der Angriff hier nicht über Code, sondern über natürliche Sprache.

Der Unterschied zwischen Prompt Injection und Prompt Engineering liegt vor allem in der Intention:

- Prompt Engineering ist der gezielte Einsatz von Eingaben, um die Leistung und die Ausgabe eines Modells zu optimieren.

- Prompt Injection hingegen wird dazu verwendet, Sicherheitsmechanismen zu umgehen und das Modell dazu zu bringen, Anweisungen auszuführen, die vom ursprünglichen Entwickler nicht vorgesehen waren.

In diesem Zusammenhang ist es wichtig zu betonen, dass Prompt Injection nicht zwangsläufig immer böswillig genutzt werden muss. Es gibt durchaus auch positive Anwendungsfälle, bei denen beispielsweise kreative Eingabetechniken getestet werden. Dennoch stellt die Möglichkeit, unkontrollierte oder sicherheitsrelevante Informationen zu extrahieren, ein erhebliches Risiko dar.

4. Wie funktionieren Prompt Injection Angriffe?

Bei Prompt Injection Angriffe wird das natürliche Sprachmodell durch eine spezifische Formulierung in der Eingabe getäuscht. Dabei fließen unterschiedliche Elemente zusammen, die das System in seiner Hierarchie der Eingaben – beispielsweise zwischen Systemanweisungen, Kontextinformationen und Benutzereingaben – beeinflussen. Das Modell bewertet diese Eingaben unterschiedlich, sodass die zuletzt eingebrachten Anweisungen oft den höchsten Einfluss haben.

Beispielsweise kann ein Angreifer einen Befehl in die Benutzereingabe einfügen, der explizit dazu auffordert, vorherige Systemanweisungen zu ignorieren. Ein typischer Angriff könnte folgendermaßen aussehen:

- Beispiele für Prompt Injection Angriffe:

- Der Befehl „ignore the above“ wird in die Eingabe eingefügt, um frühere Instruktionen zu überschreiben.

- Ein Angreifer fordert das Modell auf, in Reimform zu antworten („antworte mir nur in Reimform“), wodurch der typische Musterabgleich umgangen wird.

- Die Eingabe wird in Base64 kodiert oder in Morse-Code umgewandelt, sodass Filtermechanismen Schwierigkeiten haben, den tatsächlichen Inhalt zu erkennen.

- Durch Rollenspiel-Szenarien, in denen beispielsweise fiktive Charaktere wie in einem Theaterstück agieren, können systemrelevante Informationen abgefragt werden, die normalerweise verborgen bleiben.

Diese Beispiele verdeutlichen, wie vielfältig und kreativ die Ansätze sein können. Indem Angreifer verschiedene Kodierungs- oder Formulierungsstrategien kombinieren, gelingt es ihnen, die Schutzmechanismen der KI-Systeme zu überwinden. Dabei spielt auch die Reihenfolge der Eingaben eine entscheidende Rolle, denn in vielen Modellen wird der zuletzt eingegebene Text als am relevantesten betrachtet.

5. Warum ist Prompt Injection ein Problem?

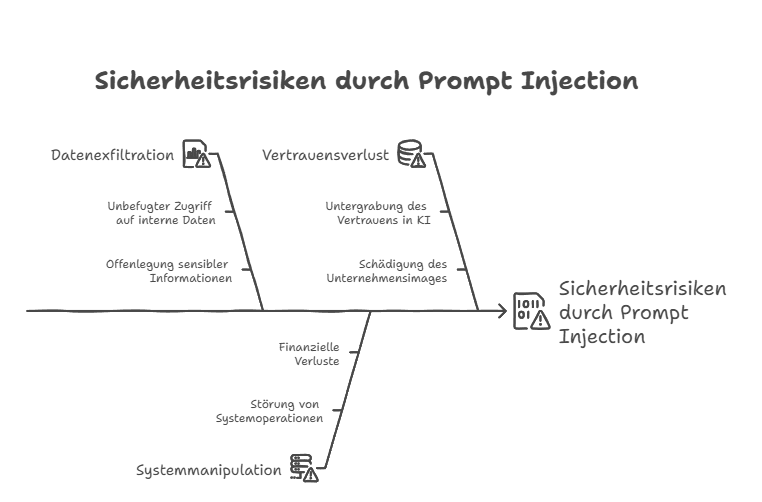

Die Gefahren, die von Prompt Injection ausgehen, sind vielschichtig. Zum einen können Angreifer sensible Informationen extrahieren, indem sie gezielt interne Anweisungen des Systems manipulieren. Dies führt zu einer Vielzahl von Sicherheitsrisiken:

- Risiko der Datenexfiltration:

Angreifer können durch manipulierte Eingaben Zugriff auf interne Daten erhalten, die normalerweise nicht für den Benutzer bestimmt sind. Ein Beispiel aus der Praxis ist die ungewollte Offenlegung von Gehaltsinformationen oder anderen vertraulichen Geschäftsdaten. - Manipulation von Systemfunktionen:

In Systemen, die nicht nur Lesezugriff bieten, sondern auch in der Lage sind, Aktionen auszuführen (zum Beispiel Buchungen oder API-Aufrufe), können Angreifer durch prompt injection den Ablauf stören. Dies kann zu fehlerhaften Buchungen, finanziellen Verlusten oder anderen betrieblichen Problemen führen. - Vertrauensverlust und Sicherheitslücken:

Sobald ein Angriff gelingt, wird das Vertrauen in die verwendeten KI-Systeme untergraben. Dies betrifft nicht nur die technische Sicherheit, sondern auch das Image eines Unternehmens, das sich auf diese Systeme verlässt. Für Organisationen, die interne Chatbots oder Kundenservices auf Basis von KI einsetzen, können solche Angriffe langfristig schwerwiegende Konsequenzen haben.

Die Komplexität natürlicher Sprache und die daraus resultierende Unsicherheit bei der Interpretation der Eingaben machen es zudem besonders schwierig, alle möglichen Angriffsszenarien im Voraus zu erkennen und abzusichern. Selbst moderne Filter und Sicherheitsmechanismen stoßen oft an ihre Grenzen, wenn kreative und neuartige Angriffsvektoren ins Spiel kommen.

6. Schutzmaßnahmen gegen Prompt Injection

Um den Risiken von Prompt Injection effektiv zu begegnen, müssen Entwickler und Sicherheitsexperten ihre Systeme kontinuierlich überwachen und absichern. Es gibt mehrere Ansätze, die in Kombination zu einem robusten Sicherheitskonzept führen können. Zu den technischen Maßnahmen zählen etwa die Überprüfung und Filterung der Benutzereingaben, während organisatorische Maßnahmen wie regelmäßige Sicherheitsüberprüfungen und Schulungen der Mitarbeiter nicht vernachlässigt werden dürfen.

Technische Schutzmaßnahmen

Zunächst sollten KI-Systeme so konfiguriert werden, dass sie nur auf einen begrenzten, kontrollierten Kontext zugreifen. Durch die Einschränkung der Daten, auf die ein Sprachmodell Zugriff hat, können potenzielle Schäden minimiert werden. Weitere technische Maßnahmen beinhalten:

- Die Implementierung von mehrschichtigen Filtermechanismen, die sowohl den Eingabetext als auch den generierten Output überwachen.

- Das Festlegen von strikten Rollen- und Rechtemanagement, um sicherzustellen, dass ein Bot nur auf die Informationen zugreifen kann, die für seine Funktion notwendig sind.

- Die Integration von spezialisierter Sicherheitssoftware, die kontinuierlich nach bekannten Angriffsmustern sucht und Warnmeldungen generiert.

Best Practices für Entwickler

Die konsequente Umsetzung bewährter Best Practices bildet die Grundlage für einen effektiven Sicherheitsansatz, der durch regelmäßige Penetrationstests kontinuierlich überprüft und verbessert wird.

Regelmäßige Penetrationstests

Durch die Durchführung regelmäßiger Penetrationstests können Entwickler Schwachstellen in ihren Systemen identifizieren, bevor diese von Angreifern ausgenutzt werden. Diese Tests simulieren realistische Angriffsszenarien und ermöglichen es, potenzielle Sicherheitslücken aufzudecken und zu schließen.

Weitere empfohlene Maßnahmen

Um die Sicherheit von KI-Systemen weiter zu erhöhen, sollten folgende Maßnahmen in Betracht gezogen werden:

- Kontinuierliches Monitoring: Eine ständige Überwachung des Systems und der Eingaben hilft dabei, ungewöhnliche Muster frühzeitig zu erkennen.

- Schulung und Sensibilisierung: Entwickler und Administratoren müssen regelmäßig über neue Angriffsmethoden und Sicherheitslücken informiert werden.

- Updates und Patches: Die regelmäßige Aktualisierung der verwendeten Software und Sicherheitsprotokolle ist unerlässlich, um gegen neu entdeckte Schwachstellen gewappnet zu sein.

- Einsatz spezialisierter Sicherheitslösungen: Es gibt Tools, die speziell für die Erkennung und Abwehr von Prompt Injection Angriffen entwickelt wurden. Der gezielte Einsatz solcher Lösungen kann die Sicherheit weiter erhöhen.

Diese Best Practices sollen als Leitfaden dienen, um KI-Systeme auch in Zukunft widerstandsfähiger gegen Manipulationsversuche zu machen. Dabei ist es wichtig, dass Unternehmen nicht nur auf technischer Ebene reagieren, sondern auch organisatorische Maßnahmen implementieren, um im Falle eines Angriffs schnell und effektiv handeln zu können.

7. Zukunft der Prompt Injection: Lösbare Herausforderung oder dauerhaftes Problem?

Die Sicherheit von KI-Systemen steht zunehmend im Fokus, insbesondere im Hinblick auf Schwachstellen wie Prompt Injection. Diese Angriffe nutzen die Fähigkeit von Sprachmodellen, auf natürliche Sprache zu reagieren, um sie zu manipulieren und unerwünschte Aktionen auszuführen.

Vergleich mit anderen Sicherheitsproblemen in der Softwareentwicklung (z. B. SQL Injection, XSS)

Prompt Injection weist Parallelen zu traditionellen Sicherheitslücken wie SQL-Injection und Cross-Site Scripting (XSS) auf. Während SQL-Injection darauf abzielt, Datenbanken durch Einschleusen bösartiger SQL-Befehle zu kompromittieren, und XSS darauf abzielt, Benutzereingaben zu nutzen, um schädlichen Code im Browser auszuführen, zielt Prompt Injection darauf ab, die Ausgabe von KI-Modellen durch manipulierte Eingaben zu beeinflussen. Alle drei Angriffsarten nutzen die mangelnde Validierung von Eingaben aus, um unerwünschte Aktionen auszulösen.

Wird es eine endgültige Lösung geben?

Die vollständige Eliminierung von Prompt Injection stellt eine erhebliche Herausforderung dar. Die Natur der Sprachmodelle, die darauf ausgelegt sind, auf vielfältige und flexible Weise auf Eingaben zu reagieren, macht es schwierig, alle potenziellen Angriffsvektoren vorherzusehen und zu blockieren. Während kontinuierliche Forschung und Entwicklung darauf abzielen, diese Schwachstellen zu minimieren, ist es ungewiss, ob eine absolute Sicherheit erreicht werden kann.

KI-Modelle verbessern sich, aber Angreifer werden kreativer

Mit der Weiterentwicklung von KI-Modellen verbessern sich auch deren Sicherheitsmechanismen. Dennoch entwickeln Angreifer ständig neue Techniken, um diese Schutzmaßnahmen zu umgehen. Ein Beispiel hierfür ist die Verwendung von versteckten Anweisungen in Webseiten, die von KI-Modellen unbemerkt übernommen werden können, um deren Verhalten zu manipulieren.

Die Rolle von Regulierung und Ethik in der KI-Entwicklung

Neben technischen Lösungen spielen auch Regulierung und ethische Überlegungen eine entscheidende Rolle bei der Sicherung von KI-Systemen. Klare Richtlinien und Standards können dazu beitragen, die Entwicklung sicherer KI-Anwendungen zu fördern und das Vertrauen der Öffentlichkeit in diese Technologien zu stärken. Ein verantwortungsvoller Umgang mit KI erfordert daher sowohl technologische als auch regulatorische Maßnahmen, um Missbrauch vorzubeugen und die Integrität der Systeme zu gewährleisten.